其原理可以分为以下几个方面。

一文看懂chatgpt原理

其原理可以分为以下几个方面:

其结构包括多个编码器和,可以用来生成文本序列。GPT-2使用了多头注意力机制和残差连接等技术,可以处理长文本序列,在文本和生成等任务上表现出色。

2. 对话生成架构

ChatGPT在GPT-2的基础上,针对对话生成任务进行了一些改进。第1,将对话内容分成多个对话回合,每个回合前面加上对话者的标识符。与此同时,将这些对话回合按时间顺序输入到模型中,模型会基于之前的回合生成接下来的回合内容。这种架构可以帮助模型更好地理解对话的上下文和语义。

3. Fine-tuning技术

ChatGPT使用Fine-tuning技术来对模型进行训练。Fine-tuning是一种迁移学习技术,可以用于将一个已经训练好的模型应用到一个新任务上。在ChatGPT中,模型使用已有的GPT-2模型进行初始化,然后在大型对话数据集上进行Fine-tuning,以适应对话生成任务。

4. Beam Search算法

ChatGPT使用Beam Search算法来生成对话回复。Beam Search算法是一种贪心算法,可以在保证效率的情况下寻找最优解。在对话生成中,Beam Search算根据每个生成的词的概率进行搜索,按照一定的宽度限制生成多个备选回复,并选择概率最高的回复作为最终生成的回复。

总结来说,采用Fine-tuning技术和Beam Search算法来实现对话生成任务。它可以让机器能够自动地进行对话,为人机交互和聊天机器人等方向提供了强大的支持。

一文看懂chatgpt模型原理

总体来说,chatgpt模型是一种基于Transformer架构的自然语言处理模型。该模型可以利用大规模文本语料库进行训练,从而实现对自然语言生成的能力。

具体来说,chatgpt模型采用了下一个单词的方法,即首先提供一些开头的单词或句子,然后基于之前的文本序列,下一个单词或句子。这种方式能够实现对自然语言上下文的理解。

在训练过程中,chatgpt模型使用了一些技术手段,如自回归模型、多头注意力机制、残差连接等,从而提高模型的训练效率和准确率。

总结来说,chatgpt模型通过下一个单词的方法,利用大规模语料库进行训练,并采用一系列技术手段来提高训练效率和准确率,从而实现对自然语言生成的能力。

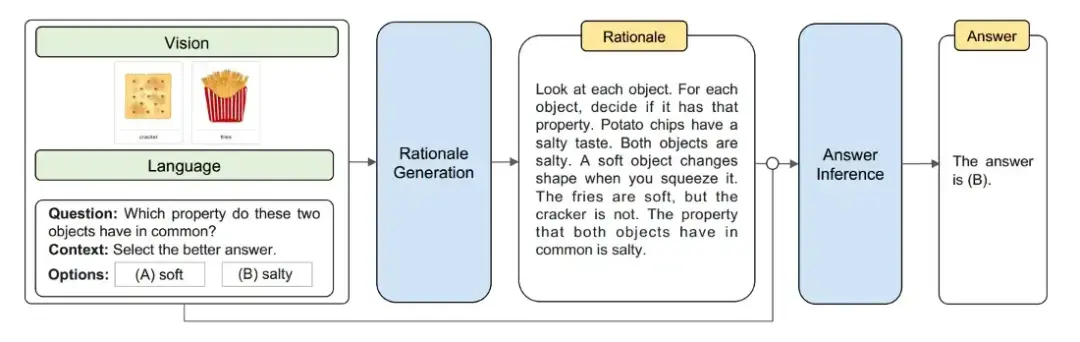

一图看懂chatgpt

ChatGPT是一个基于GPT(Generative Pre-trained Transformer)的聊天机器人,它能够与用户进行智能化的交互,第2,它还具有以下特点:

1. 自然语言处理能力:ChatGPT能够处理自然语言的输入,并根据其理解用户的意图,给出合适的回答。第3,它还能够识别用户的情感,并作出相应的反应,从而更好地了解用户的需求。

2. 智能问答能力:ChatGPT具有强大的问答能力,能够回答用户的各种问题,无论是关于文化、历史、地理、科技等方面的问题,还是关于日常生活的种种疑问,都能够得到ChatGPT合适的回答。

3. 实时反馈能力:ChatGPT可以根据用户的反馈进行自我修正,不断优化自身的回答能力。当用户提出新的问题时,ChatGPT会通过学习来逐步理解问题的意图,并给出更好的回答。

综上所述,ChatGPT是一款具有自然语言处理能力、智能问答能力以及实时反馈能力的聊天机器人,它具有智能化、个性化的交互能力,可以为用户带来更高效、更丰富的沟通体验。

chatgpt一图看懂

其工作原理可以通过以下步骤进行解释:

1. 第1,ChatGPT需要收集足够的数据来训练GPT-2模型。这些数据可以来自各种不同的来源,例如电子邮件、社交媒体平台、新闻文章和网站内容等。

2. 接下来,ChatGPT使用GPT-2模型对收集到的数据进行预处理,以便能够更好地理解人类语言。

3. 当用户与ChatGPT进行交互时,ChatGPT将输入的信息转换为文本,并使用GPT-2模型进行处理。GPT-2模型会通过下一个最有可能出现的单词来生成下一句回复。

4. ChatGPT会根据GPT-2模型生成的回复来生成自己的回复,并将其发送回给用户。ChatGPT还可以通过学习用户交互历史来逐渐适应用户的口吻和喜好,从而提供更加符合用户需求的回复。

总的来说,ChatGPT利用了GPT-2模型的强大能力,通过对人类语言的深入理解,实现了高效、自然的聊天交互体验。

评论列表 (0)