Hello,这几天公司一直忙啊忙,没有时间更文章了,唉~。对于码迷对百度蜘蛛的分类,元芳们,这件事你怎么看?

在知乎、搜外问答,还有QQ群里面,很多同学有这样的问题:

百度爬虫多久爬一次

百度爬虫多久收录

百度爬虫多久更新

本编,将带着大家探讨百度爬虫规则频率相关的问题,我们的推导顺序还是通过现象看规律,通过规律看本质,通过本质讲对策。来吧,跟着码迷SEO,让我们一步一步解开影响百度爬虫频次的因子跟有效优化对策吧。

上一篇,码迷跟大家一块探讨了百度蜘蛛抓取规律以及蜘蛛类型。传送门:码迷SEO内参(二):百度蜘蛛类型及蜘蛛抓取规律解密。百度蜘蛛主要由收录蜘蛛(123IP开头)、以及快照蜘蛛(220IP开头)两种蜘蛛构成,通过这两种蜘蛛的访问日志情况,基本上能反映出一个网站在百度眼里是高富帅还是矮穷矬。

先看4组爬虫数据

码迷从几个站里面挑选了比较典型的爬虫日志数据,记录了收录蜘蛛(蓝色)、快照蜘蛛(橙色)每天的访问频次,生成可视化表格。我们从这里直观的分析出规律来。

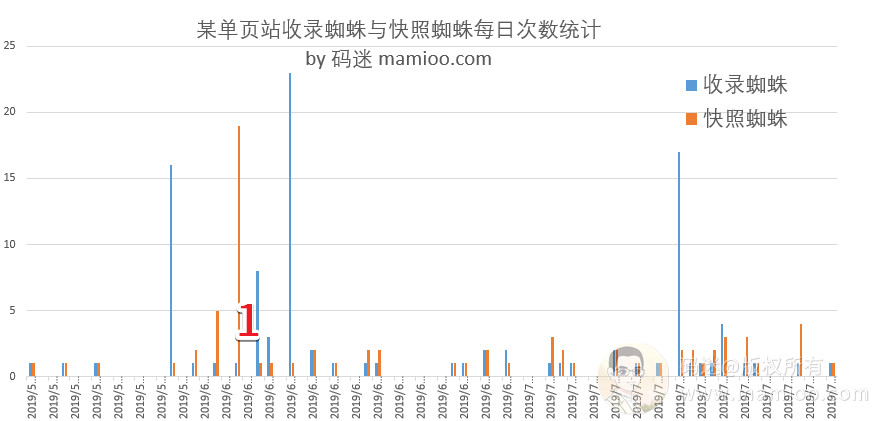

第1组 单站单页面

这个站只有一个页面,做单页SEO,19年4月份上线,用的老域名。

- 爬虫每日抓取频次不超过5次

- 上线后,有一波小访问高峰(写1的地方),爬取老域名历史页面

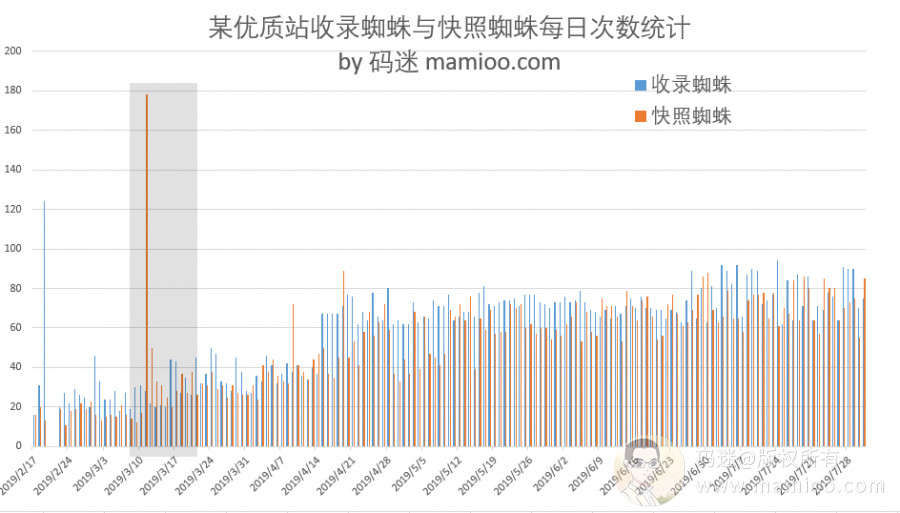

第2组 优质站持续原创

改站从1月份开始持续写文章,均为高质量原创内容,前期文章基本无快照,3月中旬左右,忽然释放大量快照。目前日pv 1000+。

- 百度爬虫造访频率基本是增长趋势

- 灰色阴影区间为大量内页忽然被收录的时间节点,与收录蜘蛛频率基本相符

第3组 垃圾站持续更新

淘的老域名,上线后采集文章做垃圾站实验,每天采集更新文章

- 灰域为两波小访问高峰,应该是蜘蛛判断老页面检测老页面访问是否正常

- 老页面正常后,百度爬虫频率趋于平稳

- 采集更新文章后,吸引了一波收录蜘蛛访问高峰(特别高的几条蓝线),页面比较低劣,没有快照蜘蛛造访

- 还是持续更新采集文章,然而爬虫频率并未大涨

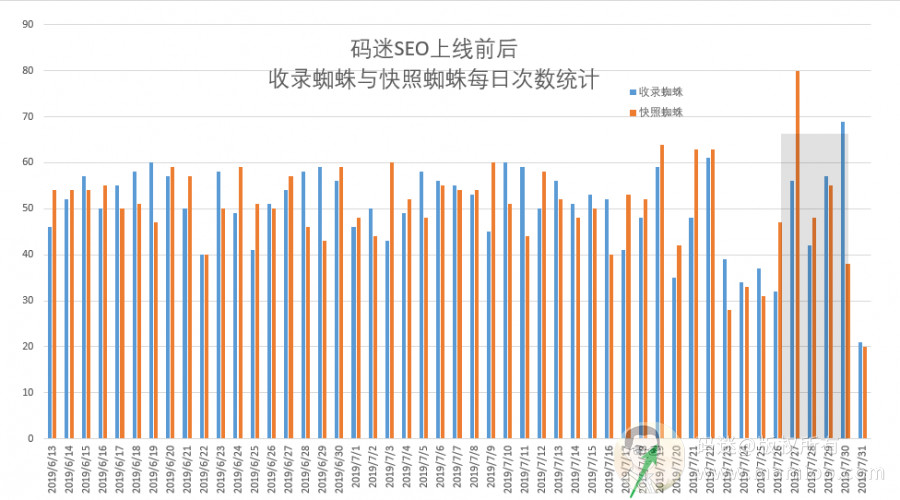

第4组 MAMIOO.COM改版上线前后

mamioo之前为母婴站点,收录1800左右,16年后无刚更新。19年7月改版上线,新增页面20个左右,之前老页面均保留。

不同时首页布局变动,之前为问答列表页,目前为摩天楼介绍,也就是首页导出链接数变少。

- 改版上线一周左右,有一波蜘蛛访问小高峰,可以理解为百度能觉出来你改版了

- 改版上线后(绿色箭头节点),整体蜘蛛访问呈下降访问趋势。也就是之前的老页面层级更深了,也会影响蜘蛛访问频率。

百度爬虫规律总结

通过以上4组数据我们基本上与我们的经验总结是相符的

1 网站页面数越多,并不代表蜘蛛访问频率越高

2 网站有快照的页面数越多,也就是网站质量越好被索引的页面越多,蜘蛛访问频率越高

3 网站链接层级越合理,与首页距离较短的页面越多,蜘蛛访问频率越高

通过百度专利探讨本质

百度爬虫多久爬一次,百度爬虫多久更新,百度爬虫爬了之后到底多久收录,带着这些问题,码迷带你一探百度的相关专利。

百度爬虫相关专利1:资源平衡性策略

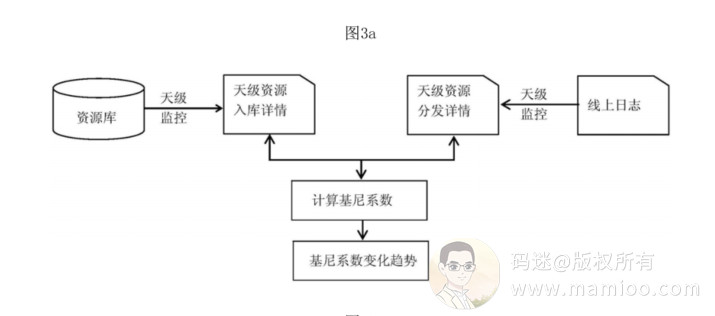

码迷觉得《201710240516.7资源平衡性的确定方法、装置、设备以及存储介质》足以解密以上很多的问题,也很能让SEOer们回味。

百度对网站的抓取策略很大程度上参考了经济学里面的基尼系数算法,来有效平衡爬虫资源分配。

百度专利是这样说的:

搜索资源是搜索引擎类产品的基石,一条资源(典型的,一个资源站点中更新的一个网页)从产生到展现给搜索用户要经历资源抓取、入库(也即将资源收录于资源库中)、召回(也即资源的分发)、排序、展现等一系列过程。其中资源的抓取、入库是召回的基础;请求召回的资源数量的多少是对资源抓取、入库质量优良的有效指标,也是影响用户体验的主要因素。在现有技术中,没有对资源库中资源的收录与分发的平衡性进行衡量的方法。

本发明实施例提供了一种资源平衡性的确定方法、装置、设备以及存储介质,通过应用衡量经济分配的公平程度的目标经济学参数的计算方法,使用设定时间区间内资源库针对各个资源站点的资源收录量以及资源分发量,计算用于衡量所述资源库的资源收录及分发的平衡性的资源平衡性参数的技术手段,创造性的给出了一种有效衡量资源库中资源的收录与分发平衡性的新方法,使得用户可以根据计算得到的资源平衡性参数,量化的感知出资源库中资源的收录与分发是否平衡,并进而可以根据该资源平衡性参数的计算结果,适应性的调整针对所述资源库的资源抓取策略。

码迷大白话:有排名的网页数量占总网站的比率才是决定爬虫抓取频率的重要指标。

百度专利还说:

[0086]

例如,可以设定一个平衡阈值条件为:0.4-0.6,如果计算得到的资源平衡性参数满足该平衡阈值条件,则可以确定当前的资源抓取策略比较合理,资源的收录及分发过程比较平衡;如果计算得到的资源平衡性参数不满足该平衡阈值条件,则可以确定当前的资源抓取策略不太合理,进而可以获取资源收录量与资源分发量之间的差值超过设定门限(例如,资源收录量-资源分发量大于1000,或者资源分发量-资源收录量大于1000等)的异常资源站点。

[0087]相应的,根据所述异常资源站点的资源收录量与资源分发量之间的差异类型(资源收录量大于资源分发量,或者资源分发量大于资源收录量),对所述异常资源站点的资源抓取策略进行适应性调整(例如:增大或者减小对所述异常资源站点的抓取频率,和/或抓取深度等)。

码迷大白话:垃圾内容越发越没爬虫来

百度爬虫相关专利2:爬虫对IP、域名分配策略

《CN201010600048.8一种网站数据抓取装置及方法》

本发明提供了一种网站数据抓取装置及方法,以更合理并且快速的调度抓取网站数据,使得在有限的资源下尽可能地使搜索引擎所抓取的网站数据能够保持较高的更新水平。

[0005] 具体方案如下 :提供一种网站数据抓取方法,包括 :a. 获取多条爬虫日志,以形成日志文件,其中所述每一爬虫日志包括相互关联的站点名称、IP 地址、网站数据以及抓取时间 ;b. 以所述站点名称为基准将所述日志文件合并到合并日志文件中,在所述合并日志文件中,每一所述站点名称下关联有一个或多个在所述爬虫日志中与所述站点名称相关联的IP 地址,每一所述站点名称下进一步关联有在所述爬虫日志中与所述站点名称相关联的抓取时间和网站数据 ;c. 以所述 IP 地址为基准对所述合并日志文件进行倒排处理,以获取倒排日志文件,在所述倒排日志文件中,每一所述 IP 地址下关联有一个或多个在所述合并日志文件中与所述 IP 地址相关联的站点名称,每一所述站点名称进一步关联有在所述合并日志文件中与所述站点名称相关联的抓取时间和网站数据 ;d. 对所述倒排日志文件中每一所述 IP 地址下的站点名称进行应用策略计算,以获取多个以优先级别排列的待抓取站点名称以及对应的待抓取 IP 地址,形成待抓取列表。

码迷大白话:同IP网站优先抓取权重高的网站,抓取次数按照服务器性能估算来抓。假如一台服务器单日最多能1000个IP,里面有8个站,其中权重最高的站每天更新1万内容,那其他站连爬虫造访机会都没有。

针对百度爬虫的SEO优化策略

百度专利里面说了,网页被搜到被点击的几率,网站整个网页数量、IP资源分配都可以影响爬虫造访频率,通过以上百度分析,码迷总结了一个爬虫频率公式如下,暂且叫码迷爬虫频率公式吧

百度爬虫频率 = 链接发现几率 * 有效排名页面占比 * 有效收录页面数量 - 同IP其他网站数*其他网站权重

很明显我们要吸引百度爬虫蜘蛛,可以通过以下手段

策略1 增加链接发现几率

如果网站外链越多,爬虫发现的几率也越大。所以很多人问:蜘蛛池有用吗?

码迷并没有找到外链与爬虫之间的关系,但是通过以往的经验来看,一个网站的有效外链越多,越容易获得百度蜘蛛发现,蜘蛛池只是提高网页被蜘蛛的爬取几率,但是码迷这里还没有证据证明,蜘蛛池能够提高有效收录率。

蜘蛛池是有效的,但是蜘蛛池本质上是一个站群系统,如果蜘蛛池里面内容都是灰色地带的内容,做合法行业的网站建议尽量保持距离。

策略2 增加有效排名页面占比 以及 有效收录页面数量

新站如何吸引爬虫?我的网站上线好久了,发了好多内容,为什么没有收录?

持续的优质内容输出,一方面增加百度有效收录率,另一方面增加搜索曝光率才是最重要的吸引蜘蛛的途径。

如果你耗费了百度的爬虫资源就算了,百度即使收录了你的网页,但是却没有人来搜或者没有前三页的排名。百度如果觉得你的网站辣么多内容木有人用,这跟狼来了的故事是一个道理。

策略3 将网站迁移到单独的IP地址

这个不展开说明了

策略4 高级爬虫吸引手段

做某些行业的老师都会搭配蜘蛛池来增加链接发现的几率,利用泛目录程序生成海量的内容页面,增加有效收录页面数量。这个时候要怎么让百度觉得你产生的网页有人搜,有人看,才能提高有效排名页面占比,那么你刷快排了吗?

针对网友的问题

百度爬虫多久爬一次?

这个取决于你的网站页面数、网站质量,一般单页站点在每天1次左右。你从百度获取的流量越多,爬虫也爬的越勤奋。

百度爬虫多久收录?

首先,新站爬取后,并不会立马收录,如果内容质量好,并持续增加内容,预计1个月左右。

其次,优质老站当日就有收录,也就是秒收。

最后,垃圾站取决于你的态度,垃圾内容越多,越不收录。

百度爬虫多久更新?

分两种情况,

第1种,网站内容被爬虫访问后,如果内容质量垃圾,收录蜘蛛访问后1-3天内,如果没有快照蜘蛛访问,多久都不会有更新。

第2种,网站内容质量好,快照蜘蛛访问后一般1-3天内快照必然更新,否则是你的站没有过考察期,要等1-3个月不等。

文末福利

今天就这些,下一节我们将拿一个案例来分析。微信公众号优质评论前10名将会获得码迷整理的66个百度专利,先到先得。

本系列首发于www.mamioo.com,同步发布于公众号”码迷SEO“,未经允许不可转载。

关于码迷:

7年SEOer,摩天楼内容助手作者,专注SEO算法研究,精益科学SEO鉴定倡导者。QQ709808807,欢迎志同道合加我交流。

评论列表 (0)